Open Responses

概览

OPL 数据空间对 Open Responses 提供实验性支持。它是一套开放规范,用于在多 provider 之间统一 LLM 的请求与响应结构。本指南介绍如何为某个连接启用 Responses API。

该功能目前仍处于实验阶段,并不保证所有 provider 都能正常工作。

什么是 Open Responses

Open Responses 是一个开源规范,用来统一不同 provider 的 LLM 输入输出格式。它的主要价值包括:

- 一套规范,对接多个 provider:只描述一次输入输出,就能运行在 OpenAI、Anthropic、Gemini 或本地模型之上。

- 可组合的 agentic 循环:统一流式输出、工具调用和消息编排。

- 更容易做评估和路由:可以用统一 schema 比较 provider、做流量路由并记录结果。

它基于 OpenAI Responses API 的格式,但目标是适配任何实现该规范的 provider。

第 1 步:新增或编辑连接

- 打开 ⚙️ 管理设置。

- 前往 连接 > OpenAI > 管理。

- 点击 ➕ 添加新连接,或编辑一个已有连接。

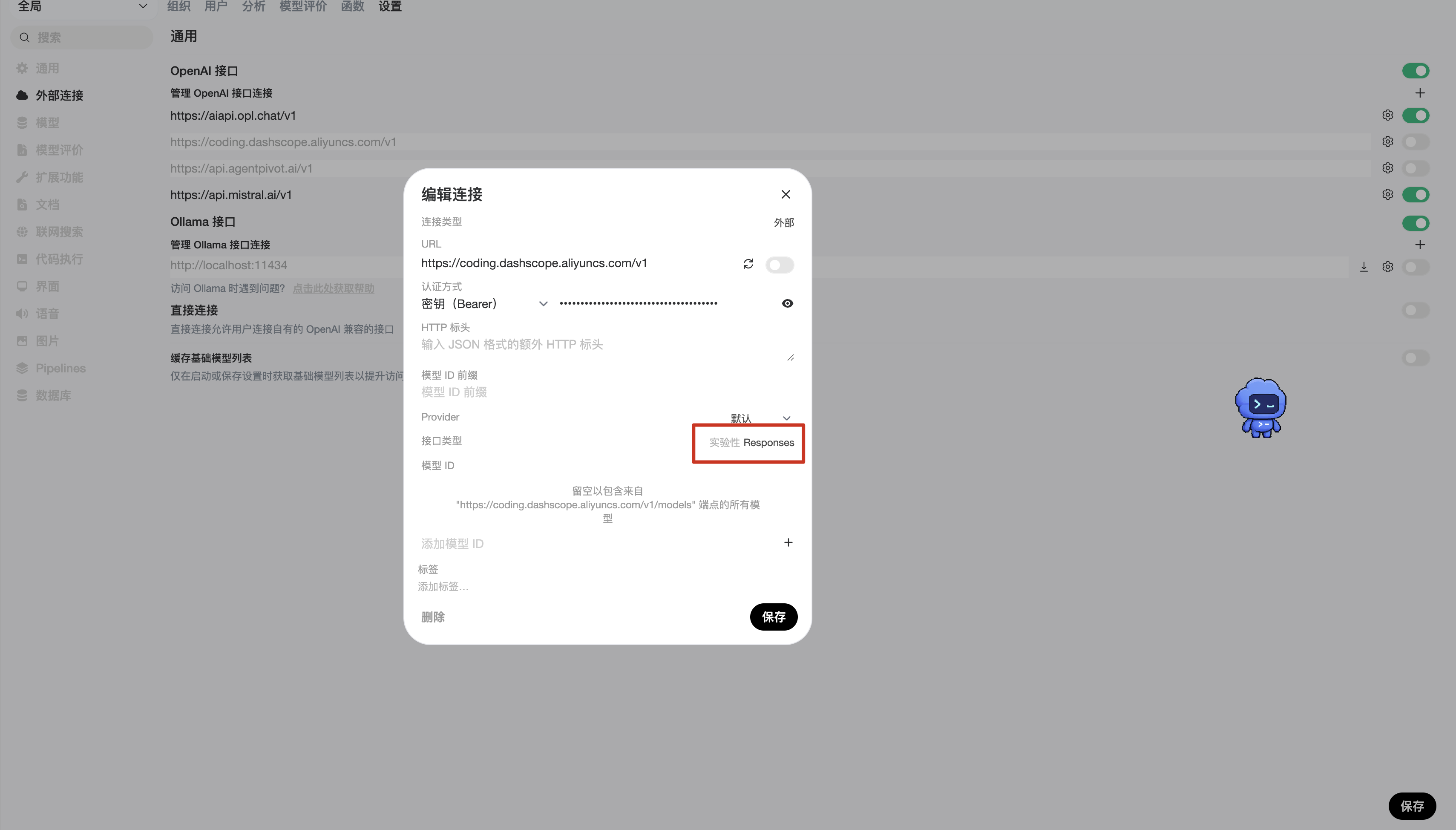

第 2 步:选择 API 类型

在连接配置弹窗中找到 API Type:

- Chat Completions:默认选项,使用标准 OpenAI Chat Completions 格式。

- Responses:实验性选项,使用 Open Responses 格式。

切换到 Responses 后,你会看到“Experimental”标签,表示该能力仍在开发中。

第 3 步:配置 provider

填写支持 Open Responses 格式的 provider 连接信息:

- URL:provider 的 API 地址

- API Key:认证凭据

- Model IDs:可选,限制可用模型

支持情况

Open Responses 仍是较新的规范,provider 支持范围还在持续扩展。请查看 Open Responses 官网 获取最新兼容实现列表。

故障排查

Chat Completions 能用,但 Responses 不行

并非所有 provider 都支持 Open Responses。可以尝试:

- 切回 Chat Completions

- 确认 provider 是否明确支持 Open Responses

- 使用能转换成 Open Responses 的中间代理

流式输出或工具调用表现异常

Responses API 连接支持工具调用、再次调用以及流式输出。 OPL 数据空间会在 Chat Completions 与 Responses API 之间做透明转换,包括工具参数、函数调用输出和多轮工具使用。如果仍有问题:

- 去 OPL 数据空间 Discord 查已知问题

- 到 GitHub 提交问题

Stateful sessions

默认情况下, OPL 数据空间会把 Responses API 连接当作 无状态 连接处理,也就是本地维护对话历史,并在每次请求时发送完整上下文。

如果你的上游 provider 支持 有状态会话,即服务端存储响应并通过 previous_response_id 关联上下文,例如直接连接 OpenAI,那么可以开启:

ENABLE_RESPONSES_API_STATEFUL=true这样会把会话状态交给上游 provider 管理。

多数代理和第三方 Responses API 端点都是无状态的,如果错误开启有状态模式,通常会导致异常。仅在 provider 明确支持时开启。

进一步阅读

- Open Responses 规范:完整技术规范

- Open Responses GitHub:源码与讨论

- FAQ:为什么 OPL 数据空间不直接支持各家私有 API?:了解协议优先的设计取向