Public Storage 通过 OPL 数据�空间在各企业职能中扩展安全的 AI 平台

概览

Public Storage 采用 champion-driven rollout 的方式,在 GCP 上基于 OPL 数据空间 部署了安全、私有的生成式 AI 平台,在 30 天内达到约 50% 活跃采用率,并把一个关键运营工作流缩短了 80% 以上。

关键数据

- 用户数:5000–10000 员工

- 区域:美国

- 行业:房地产

- 部署方式:GCP(容器化、私有网络)

- 模型:Anthropic Claude、OpenAI GPT、Llama、Gemma

- 上线节奏:2 周试点,30 天内全面可用

- 采用情况:首月约 50% 活跃使用

- 结果:运营流程显著提速、跨职能采用��、企业级治理落地

关于 Public Storage

Public Storage 是一家财富 500 强自助仓储 REIT,在美国运营 3000 多个设施。

挑战:在企业范围内安全扩展 AI

当生成式 AI 工具快速走红时,Public Storage 很快意识到机会与风险并存。各团队开始自行试用 AI,逐渐形成一堆零散订阅和不受治理的用法。

管理层提出了明确目标:提供一个 安全、集中式 AI 平台,既能提升组织整体的 AI 素养,又能发现高价值业务场景并稳定释放效率收益,同时不牺牲数据安全与合规性。

关键要求

- 在企业 GCP 环境中 私有部署

- 仅允许企业认证员工通过防火墙内访问

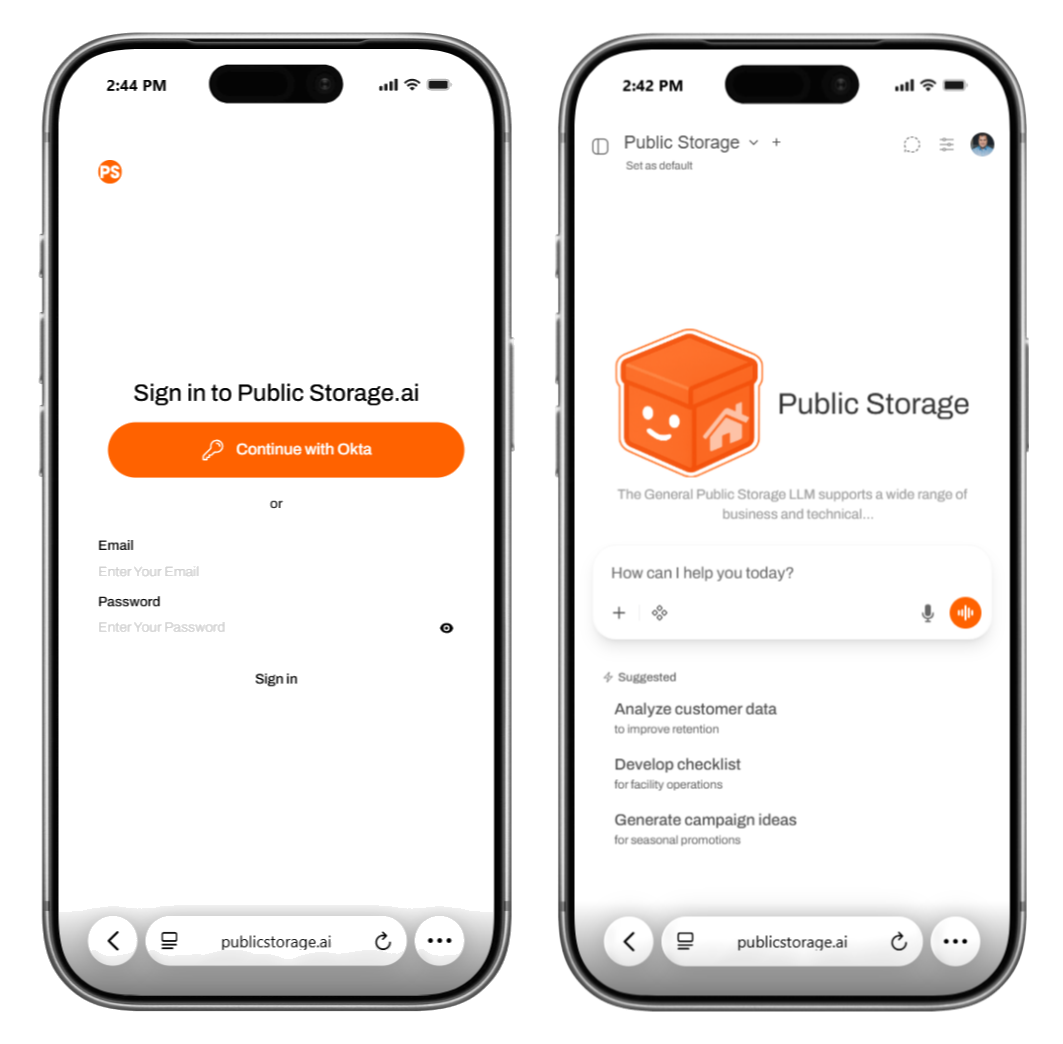

- 接入现有 Okta SSO

- 避免 provider / 单一 LLM 锁定

- 完整审计轨迹、DLP 和 PII 脱敏

- 按群组的 RBAC

方案:部署在 GCP 上的 OPL 数据空间

OPL 数据空间被选中的关键原因,是它具备 可扩展基础架构:它既能作为简单聊天界面迅速落地,又能逐步演化成安全、多模型、受治理的内部 AI 平台。

架构亮点

- 计算 / 编排:GCP 上的容器化工作负载,按内部需求自动扩缩

- 存储 / 数据库:托管 PostgreSQL 与安全对象存储

- 网络:私有网络;仅公司内部认证员工可访问

- CI/CD:自动化升级管线

- 日志 / 监控:GCP 原生工具与 Langfuse

- 安全控制:MFA、RBAC、数据驻留、PII 脱敏、中断式提醒、审核导出、DLP、出口限制

“我们的目标不只是部署 AI,而是负责任地扩展它。 OPL 数据空间让我们能够在保持治理能力的同时,由业务部门共同发掘高价值使用场景。” — Public Storage CTO

模型与数据处理

Public Storage 采用 多模型策略 来平衡能力、隐私与成本:

- 主力:Anthropic Claude(零数据保留)

- 高频�场景:OpenAI GPT(零数据保留)

- 开源权重:Llama 与 Gemma,用于更私有的场景

- RAG:默认 Sentence Transformers,用于 embedding,并持续优化检索性能

- PII 处理:自定义过滤器会在敏感信息到达模型前进行 剥离并中断处理,同时向用户展示提醒

推广与赋能

Public Storage 采用了审慎的 champion-driven rollout 模式。先通过 为期两周的试点 与指定推广 champion 验证方案,再在 30 天内面向更广组织开放。

培训聚焦于 贴近岗位的实际用法,而不是抽象的 AI 课程。团队为早期用户举办了 1.5 小时的 “PS.AI Orientation”,结合真实示例和最佳实践。

在首月内:

- 约 50% 已 onboarding 用户 成为活跃用户

- 随着团队之间分享成功工作流,使用持续增长

- 几乎所有企业职能都已覆盖,包括 HR、市场、财务、法务、客服、运营、IT 等

结果:生产力、采用率与治理

01. 运营时间节省

例如,一位区域经理把每周 4 小时的预约审查流程缩短到约 40 分钟,降幅超过 80%。

02. 跨职能采用

首月 约 50% 活跃使用率,并且很多工作流是业务部门自己构建并在团队间传播的。

03. 企业级治理

- 完全私有部署

- PII 脱敏、审核导出、DLP 与 moderation guardrail

- RBAC、MFA 与出站限制提供多层安全防护

典型使用场景

- 预约分析

- 一线与内部沟通文案起草

- 内部政策与流程检索

- 跨部门 AI agent 和工作流试验

为什么选择 OPL 数据空间

- 可扩展基础:从�聊天界面演进成完整内部 AI 平台

- 多模型灵活性:商用与开源权重模型并存

- 企业治理能力:PII 脱敏、审计轨迹、RBAC、DLP

- 快速部署

- 开放架构:便于持续迭代而不依赖单一供应商

如果你正在评估 Enterprise Plan,可以直接联系销售团队。